- 据The Information报道,有参与芯片和服务器硬件生产的匿名消息人士透露,由于设计出现问题,英伟达有可能会推迟Blackwell架构产品的出货时间,延期三个月或更长时间,预计会影响到Meta、谷歌和微软等主要客户。台积电原本计划在第三季度开始量产Blackwell系列芯片,并从第四季度开始向英伟达客户批量发货。然而,由于设计缺陷的发现,量产时间不得不推迟到第四季度,批量出货的时间预计要推迟到明年第一季度。不过摩根士丹利在最新报告中对Blackwell芯片的前景表示乐观,认为生产仅会暂停约两周,并

- 关键字:

英伟达 AI 芯片 Blackwell GPU

- 8月5日消息,近日有关NVIDIA新款AI芯片Blackwell因设计缺陷而推迟发布的消息,引起了广泛关注。对此,NVIDIA方面表示:"Hopper的需求非常强劲,Blackwell的样品试用已经广泛开始,产量有望在下半年增加。除此之外,我们不对谣言发表评论。"此前,有外媒报道称,Blackwell芯片可能因设计问题而推迟发布三个月甚至更长时间,这将影响到包括Meta、谷歌和微软在内的多家大客户,他们已经预订了价值数百亿美元的芯片。此外,还有消息人士透露,NVIDIA已经向微软等客户

- 关键字:

Blackwell AI 芯片 NVIDIA 样品试用

- 英伟达推迟出货B200,对营收影响几何?据科技媒体The Information报道,英伟达向其客户表示,新款Blackwell B200芯片将延迟发布三个月或更长时间,批量出货或延迟至明年Q1。Blackwell芯片原计划于2024年10月开始批量生产,若因延期而推迟至2025年4月,将直接影响英伟达的季度收益。对此,英伟达回应媒体称,对Hopper芯片的强劲需求和Blackwell芯片的生产计划并未改变。英伟达发言人表示:“正如我们之前所说,Hopper的需求非常强劲。大规模的Blackwell采样工

- 关键字:

AI 芯片 英伟达 B200 Blackwell GPU Meta 微软

- Supermicro, Inc.(NASDAQ:SMCI)作为AI、云端、储存和 5G/边缘领域的全方位IT解决方案制造商,推出可立即部署式液冷型AI数据中心。此数据中心专为云端原生解决方案而设计,透过SuperCluster加速各界企业对生成式AI的运用,并针对NVIDIA AI Enterprise软件平台优化,适用于生成式AI的开发与部署。透过Supermicro的4U液冷技术,NVIDIA近期推出的Blackwell GPU能在单一GPU上充分发挥20 PetaFLOPS的AI效能,且与较早的GP

- 关键字:

Supermicro NVIDIA Blackwell HGX 液冷AI SuperCluster

- 6月3日消息,英伟达创始人兼CEO黄仁勋在台北国际电脑展上宣布,英伟达Blackwell芯片正式投产。Blackwell芯片,作为英伟达的新一代产品,宣称是“全球最强大的芯片”。第一款Blackwell芯片名为GB200,它拥有2080亿个晶体管,采用台积电4NP工艺制造,这一工艺是专为Blackwell GPU定制的双倍光刻极限尺寸工艺。GB200的架构旨在满足未来AI工作负载的需求,为全球机构构建和运行实时生成式AI提供了可能,同时其成本和能耗比上一代Hopper GPU架构降低了25倍。黄仁勋还透露

- 关键字:

英伟达 Blackwell 芯片

- IT之家 5 月 23 日消息,消息称英伟达的 Blackwell GB200 人工智能服务器 2024 年预估出货量为 50 万片,而在 2025 年将达到 200 万片,此外英伟达正探索采用全新的封装技术。英伟达 Blackwell GB200 产能当前正面临 HBM 和 CoWoS 封装产能影响,根据《经济日报》报道,英伟达的 GB200 AI 芯片将采用“面板级扇出式封装”(panel-level fan-out packaging,简称 PFLO )方案,计划在 2025 年

- 关键字:

英伟达 GPU 计算平台 Blackwell GB200

- 据英国金融时报报道,亚马逊的云计算部门已经停止了英伟达最先进的“超级芯片”的订单,以等待功能更强大的新型号。亚马逊网络服务公司(Amazon Web Services)称,该公司已经“完全过渡”了此前订购的英伟达Grace Hopper芯片,并用其后续产品Grace Blackwell取而代之。据了解,英伟达在今年3月公布新一代处理器架构Blackwell,距离上一代产品Hopper开始向客户发货仅一年。英伟达首席执行官黄仁勋(Jensen Huang)表示,新产品训练大型语言模型(LLM)——OpenA

- 关键字:

英伟达 亚马逊 Blackwell

- 随着人工智能革命席卷而来,抓住生成式AI机会的英伟达全面出击,为大小挑战者设下新标杆。3月19日,英伟达在2024年GTC大会上发布Hopper架构芯片的继任者 —— 全新Blackwell架构芯片平台,包括AWS、微软和谷歌在内的公司计划将其用于生成人工智能和其他现代计算任务。

- 关键字:

英伟达 Blackwell 芯片 GPU AI

- ● 全新Blackwell GPU、NVLink和可靠性技术赋能万亿参数规模的AI模型● 全新Tensor Core与TensorRT-LLM编译器将LLM推理运行成本和能耗降低多达25倍● 全新加速器助推数据处理、工程模拟、电子设计自动化、计算机辅助药物设计和量子计算领域实现突破● 各大云提供商、服务器制造商和头部AI企业纷纷采用NVIDIA于近日宣布推出NVIDIA Blackwell平台以赋能计算新时代。

- 关键字:

NVIDIA Blackwell GPU

- NVIDIA于近日发布新一代AI超级计算机 —— 搭载NVIDIA GB200 Grace Blackwell超级芯片的NVIDIA DGX SuperPOD™。这台AI超级计算机可以用于处理万亿参数模型,能够保证超大规模生成式 AI 训练和推理工作负载的持续运行。全新 DGX SuperPOD 采用新型高效液冷机架级扩展架构,基于NVIDIA DGX™ GB200系统构建而成,在FP4精度下可提供 11.5 exaflops

- 关键字:

NVIDIA Blackwell DGX SuperPOD 万亿参数级 生成式AI 超级计算

- 3 月 18 日消息,英伟达将在明日举行GTC 2024 主题演讲,黄仁勋预计将宣布名为 Blackwell 的下一代 GPU 架构。据 XpeaGPU 爆料称,明天推出的 B100 GPU 将采用两个基于台积电 CoWoS-L 封装技术的芯片。CoWoS(晶圆基片芯片)是一项先进的 2.5D 封装技术,涉及将芯片堆叠在一起,提高处理能力,同时节省空间并降低功耗。XpeaGPU

透露,B100 GPU 的两个计算芯片将连接到 8 个 8-Hi HBM3e 显存堆栈,总容量为 192GB。值得注意的是,

- 关键字:

英伟达 Blackwell B100 GPU 显存 CoWoS

- 今年8月,SK海力士宣布开发出了全球最高规格的HBM3E内存,并将从明年上半年开始投入量产,目前已经开始向客户提供样品进行性能验证。据MT.co.kr报道,继第4代产品HBM3之后,SK海力士将向英伟达独家供应第五代高带宽内存HBM3E,此举有望进一步巩固其作为AI半导体公司的地位。据半导体业界15日消息,SK海力士将于明年初向英伟达提供满足量产质量要求的HBM3E内存,并开展最终的资格测试。一位半导体行业高管表示,“没有HBM3E,英伟达就无法销售B100”,“一旦质量达到要求,合同就只是时间问题。”据

- 关键字:

英伟达 GPU Blackwell B100 HBM3E 显存

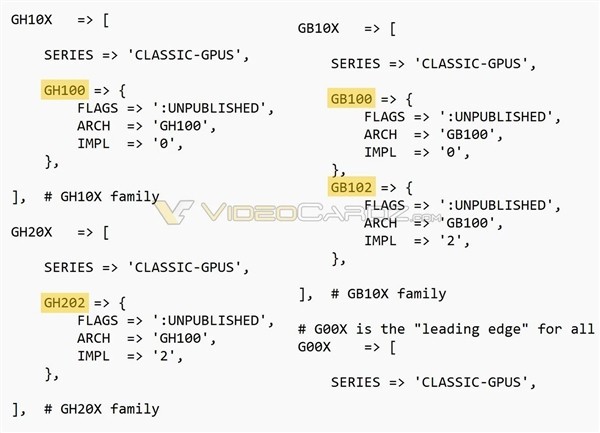

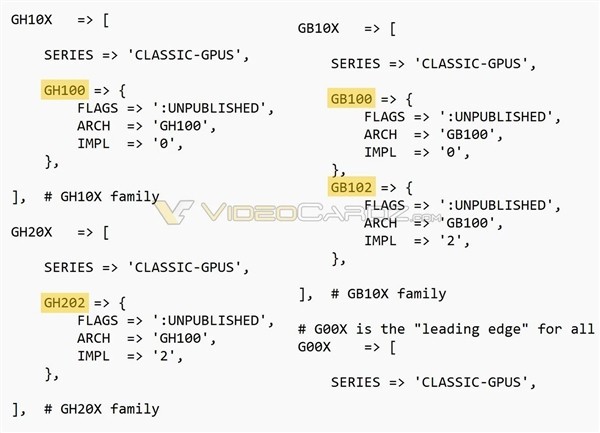

- 近日,在Arete技术大会上,NVIDIA副总裁、数据中心业务总经理Ian Buck确认了会在2024年推出Hopper继任者的消息。根据爆料,取代Hopper的下代GPU代号Blackwell。在此之前,外界就曾挖到名为GB100和GB102的新核心,算是比较有力的证据。据称NVIDIA正与台积电协作,致力于采用3nm工艺节点来制造Blackwell GPU。从规格上来看,当前的Hopper的计算密度比RTX 4090还要高,下一代Blackwell肯定会更加强力。稍稍遗憾的是,到底RTX 5

- 关键字:

NVIDIA Blackwell

blackwell介绍

您好,目前还没有人创建词条blackwell!

欢迎您创建该词条,阐述对blackwell的理解,并与今后在此搜索blackwell的朋友们分享。

创建词条

关于我们 -

广告服务 -

企业会员服务 -

网站地图 -

联系我们 -

官方威廉希尔备用网址

-

友情链接 -

手机EEPW

Copyright ©2000-2015 ELECTRONIC ENGINEERING & PRODUCT WORLD. All rights reserved.

威廉希尔 官网app

杂志社 版权所有 北京东晓国际技术信息咨询有限公司

京ICP备12027778号-2 北京市公安局备案:1101082052 京公网安备11010802012473